ChatGPT Banned in Italy

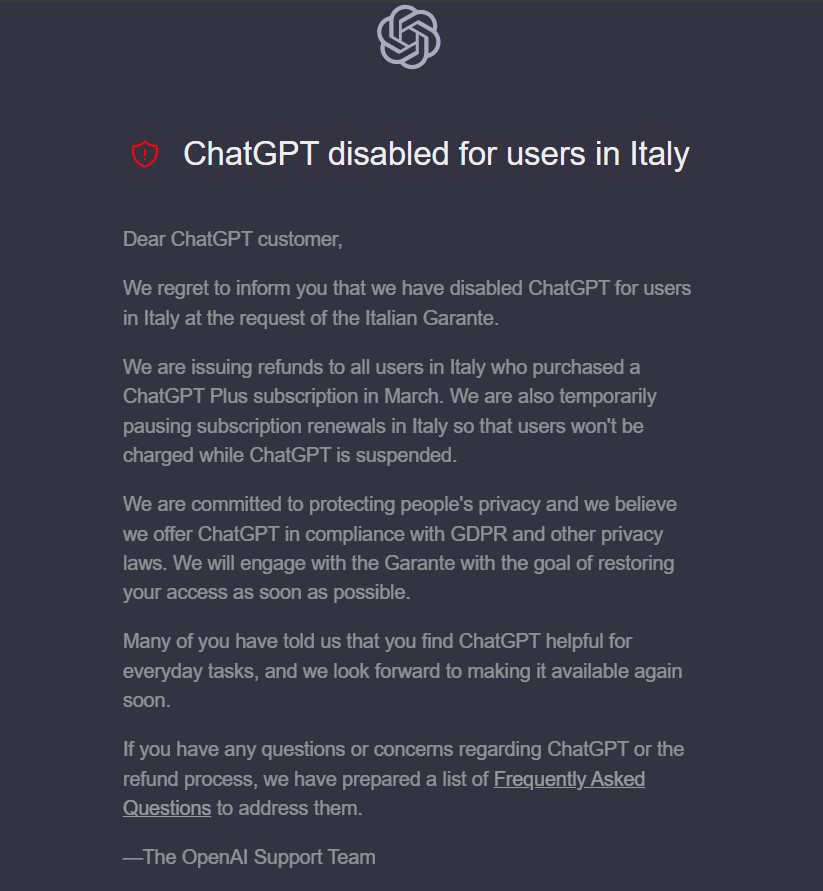

Il recente divieto di utilizzo di ChatGPT in Italia da parte dell’autorità di protezione dei dati del paese ha sollevato preoccupazioni sull’uso di chatbot e assistenti virtuali potenziati dall’AI in contesti sensibili. Questo è lo screenshot del messaggio da parte di OpenAI per gli utenti italiani:

Perchè ChatGPT è stato bandito in Italia

L’autorità italiana per la protezione dei dati (DPA) ha sollevato preoccupazioni riguardo ai potenziali rischi associati all’uso di ChatGPT in contesti sensibili, come la sanità, la finanza e i servizi pubblici. Gli algoritmi di ChatGPT sono progettati per elaborare grandi quantità di dati personali, tra cui informazioni sensibili, e potrebbero rappresentare una minaccia per la privacy e i diritti degli individui. La DPA ha anche evidenziato che i creatori di ChatGPT non hanno fornito garanzie sufficienti riguardo alla protezione e alla sicurezza dei dati degli utenti.

Implicazioni del divieto

Il divieto di utilizzo di ChatGPT in Italia ha implicazioni significative per l’uso di chatbot e assistenti virtuali potenziati dall’AI in contesti sensibili. Sottolinea la necessità di normative e standard più rigorosi per garantire la protezione della privacy e dei diritti degli utenti. Il divieto solleva anche questioni sulla trasparenza e la responsabilità delle aziende e degli sviluppatori nell’uso dell’AI e nella gestione dei dati personali.

Possibili conseguenze

Il divieto di utilizzo di ChatGPT in Italia potrebbe non necessariamente significare la fine del suo utilizzo nel paese. I suoi creatori potrebbero adottare misure per affrontare le preoccupazioni della DPA e conformarsi alle leggi sulla protezione dei dati del paese. Tuttavia, il divieto sottolinea la necessità di un uso più trasparente e responsabile dell’AI in contesti sensibili. Serve anche come promemoria sull’importanza dell’uso responsabile dell’AI in tutte le industrie.

Conclusione

In conclusione, il divieto di utilizzo di ChatGPT in Italia per motivi di violazione dei dati evidenzia le crescenti preoccupazioni e sfide associate all’uso dell’AI in contesti sensibili. Il divieto sottolinea la necessità di normative e standard più rigorosi per garantire la protezione della privacy e dei diritti degli utenti. Serve anche come promemoria sull’importanza della trasparenza, della responsabilità e dell’uso responsabile dell’AI in tutte le industrie.